Федеральная торговая комиссия (FTC) играет роль ключевого регулятора систем искусственного интеллекта (ИИ), точно так же, как технологические тяжеловесы и политики требуют, чтобы федеральное правительство контролировало приложения ИИ.

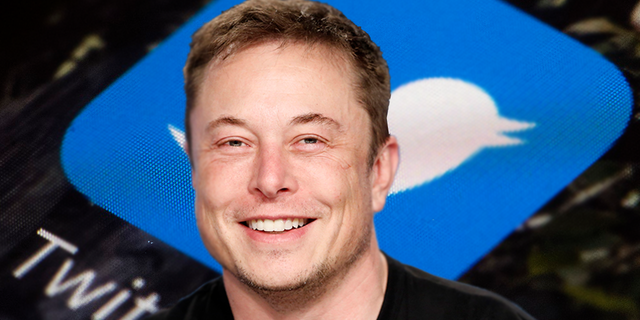

Прозвучавший на прошлой неделе призыв к мораторию на новые разработки ИИ от технологических гигантов, таких как Илон Маск и Стив Возняк, положил начало дискуссии о том, должно ли и как правительство вмешаться и установить барьеры вокруг потенциально опасных систем ИИ. Несколько законодателей ответили, что ввести мораторий будет сложно, что оставляет огромный разрыв между призывами к действию и реальностью того, насколько быстро Конгресс может действовать.

Однако на прошлой неделе FTC ясно дала понять, что готова восполнить этот пробел и предпринять шаги по регулированию новых систем искусственного интеллекта. Федеральное агентство, которому поручено следить за «обманчивой или недобросовестной деловой практикой», заявляет, что у него есть собака в этой борьбе, и оно наращивает потенциал для борьбы с угрозами, которые ИИ представляет для осторожных потребителей.

В конце марта юрист Федеральной торговой комиссии заявил, что «чат-боты», которые можно использовать для имитации человеческого языка в тексте и видео, можно использовать в качестве инструмента для разработки поддельных и вводящих в заблуждение продуктов, таких как фишинговые электронные письма, поддельные веб-сайты и посты. , а также поддельные потребительские отзывы, направленные на то, чтобы обмануть потребителей. Майкл Атлесон, юрист отдела рекламной практики FTC, указал, что FTC внимательно следит за этими событиями на предмет возможных нарушений закона о защите прав потребителей — либо разработчиками ИИ, либо компаниями, использующими продукты ИИ.

«Запрет Закона о Федеральной торговой комиссии на обман или недобросовестное поведение может применяться, если вы производите, продаете или используете инструмент, который эффективно предназначен для обмана, даже если это не является его предполагаемой или единственной целью», — предупредил он в своем выступлении. разместить на сайте FTC.

Это предупреждение было сделано непосредственно перед призывом десятков известных технических специалистов приостановить дальнейшее развитие ChatGPT OpenAI, новая версия которого была выпущена в прошлом месяце. В их письме содержится призыв к паузе в любых разработках, помимо итерации OpenAI GPT-4, из-за опасений, что она разрабатывается быстрее, чем кто-либо может подумать о том, как ее следует регулировать.

Атлесон сказал, что компаниям, разрабатывающим или использующим такого рода системы искусственного интеллекта, необходимо подумать о том, «должны ли они вообще производить или продавать их», исходя из их способности быть неправомерно использованными в мошеннических целях.

«Тогда спросите себя, достаточно ли высоки такие риски, чтобы вообще не предлагать продукт», — сказал он.

Компании также должны беспокоиться о том, снижают ли они риски того, что ИИ может быть использован для обмана клиентов, и не используются ли пользователи чат-ботов ИИ для введения клиентов в заблуждение.

«Например, дипфейки знаменитостей уже стали обычным явлением и появляются в рекламе», — сказал Атлесон. «Ранее мы предупреждали компании, что введение потребителей в заблуждение с помощью двойников, таких как поддельные профили знакомств, фальшивые подписчики, дипфейки или чат-боты, может привести — и фактически привело — к принудительным действиям Федеральной торговой комиссии».

Атлесон выступил с аналогичным предупреждением в феврале, когда подчеркнул ряд проблем, связанных с чат-ботами. Среди прочего, он предупредил, что компании-разработчики ИИ должны остерегаться «преувеличения того, что может сделать ваш продукт ИИ», а также потенциальных рисков, связанных с выводом на рынок нового продукта ИИ.

«Если что-то пойдет не так — может быть, оно даст сбой или даст необъективные результаты — вы не можете просто винить стороннего разработчика технологии», — сказал он. «И вы не можете сказать, что не несете ответственности, потому что эта технология — «черный ящик», который вы не можете понять или не знаете, как проверить».

Он также предупредил в более широком смысле, что «ИИ» стал популярным маркетинговым термином, и разработчикам нужно быть осторожными с «чрезмерным использованием и злоупотреблением» обещаниями, связанными с ИИ, просто для продажи.

«Маркетологи должны знать, что — в целях обеспечения соблюдения Федеральной торговой комиссии — ложные или необоснованные заявления об эффективности продукта — это наш хлеб с маслом», — сказал он.

На выходных другой представитель FTC заявил, что агентство наращивает потенциал для рассмотрения жалоб потребителей, связанных с ИИ. Сэмюэл Левин, директор Бюро защиты прав потребителей FTC, сказал, что FTC уже возбудила дела, связанные с ИИ, и «занимается соответствующим нормотворчеством и исследованиями рынка» по этому вопросу.

«Сегодня этот опыт, наряду с нашим гибким авторитетом и большим количеством талантов, позволяет нам предоставлять четкие и своевременные предупреждения о рисках, связанных с этой технологией», — сказал он.

«Федеральная торговая комиссия приветствует инновации, но быть новаторами — не значит быть безрассудным», — добавил Левин. «Мы готовы использовать все наши инструменты, включая правоприменение, чтобы бросить вызов вредоносной практике в этой области».

FTC набирает в агентство лучших технологов и работает с партнерами в Европе, учеными и другими людьми, чтобы оставаться в курсе последних событий.

Не сразу понятно, как Конгресс может отреагировать на агрессивный надзор FTC за ИИ. Председатель FTC Лина Хан недавно подверглась критике со стороны консерваторов за ее требование, чтобы Twitter передал список репортеров, которые были причастны к «Twitter Files», который показал, что компания координирует свои действия с федеральными чиновниками по цензуре некоторого контента Twitter. .

В то же время, однако, многие республиканцы в Конгрессе, по-видимому, поддерживают некий вид государственного надзора за ИИ из-за опасений, что разработчики из Кремниевой долины, например, вставляют левые ограничения в то, как ChatGPT отвечает на вопросы.

Одним из первых тестов способности FTC справиться с растущим интересом к регулированию ИИ является призыв Центра ИИ и цифровой политики (CAIDP) остановить любое дальнейшее развитие ChatGPT и потребовать проведения независимой оценки ИИ. инструмент чата перед дальнейшими выпусками. CAIDP, целью которого является обеспечение того, чтобы ИИ способствовал «широкой социальной интеграции, основанной на основных правах, демократических институтах и верховенстве закона», в своем заявлении в FTC утверждал, что ChatGPT «предвзят, обманчив и представляет угрозу для конфиденциальности и общественной безопасности». "

Представитель FTC только на этой неделе сообщил, что агентство получило представление CAIDP и больше не комментирует, как оно может действовать в связи с ним.

Пит Касперович — политический редактор Fox News Digital.